سيُنشر هذا المقال قريباً

موعد النشر: 2026-05-10 01:00

سيظهر المقال تلقائياً عند حلول الموعد — لا حاجة لإعادة التحميل.

معركة النماذج اللغوية المفتوحة

شهد عام 2026 نقلةً نوعيةً في عالم نماذج اللغة الكبيرة (LLM)، إذ باتت النماذج مفتوحة الوزن (open-weight) تقترب بجدية من أداء النماذج التجارية الكبرى. وفقاً لتحليلات SitePoint، الفجوة في الجودة على معايير مثل MMLU-Pro لم تعد تتجاوز 3-5% بين أفضل النماذج مفتوحة الوزن والنماذج التجارية الرائدة [citation:4].

أبرز النماذج المفتوحة في 2026

Meta Llama 4

أطلقت Meta في أبريل 2026 سلسلة Llama 4 بنمطين رئيسيين [citation:1][citation:5]:

| النموذج | المعامل النشط | إجمالي المعامل | نافذة السياق |

|---|---|---|---|

| Llama 4 Scout | 17 مليار | 17 مليار | 10 مليون رمز (قياسي) |

| Llama 4 Maverick | 17 مليار | 400 مليار (128 خبير) | 512 ألف رمز |

أبرز الميزات:

- متعدد الوسائط بشكل أصلي (نص + صورة) [citation:5]

- دعم 200 لغة في التدريب، و12 لغة مضبوطة بدقة تشمل العربية [citation:5]

- يتفوق على GPT-4o و Gemini 2.0 Flash في المعايير القياسية [citation:1]

- رخصة مجتمعية تسمح الاستخدام التجاري مع قيود للمستخدمين فوق 700 مليون شهرياً [citation:4]

Mistral Large 2

النموذج الفرنسي المفتوح الوزن الذي ينافس بقوة [citation:2][citation:6]:

- 128,000 رمز نافذة سياق

- MMLU: 84%

- سعر API: 3$ (إدخال) / 9$ (إخراج) لكل مليون رمز

- أرخص بنسبة 33% من Claude Sonnet 4.6 [citation:6]

- أداء متميز في البرمجة والمنطق والوظائف (function calling)

Qwen 3 و Qwen 3.5 (Alibaba)

أحدث إصدارات阿里巴巴 للذكاء الاصطناعي [citation:3][citation:7]:

| النموذج | الميزات الرئيسية |

|---|---|

| Qwen 3 | يدعم 119 لغة، من ضمنها العربية [citation:3] |

| Qwen 3.5 | يدعم 201 لغة، رخصة Apache 2.0، متعدد الوسائط [citation:7] |

- متوفر بأحجام متنوعة تصل إلى 235 مليار معامل بنمط Mixture-of-Experts [citation:4]

- خفيف بما يكفي للتشغيل على محطات عمل قوية محلياً [citation:8]

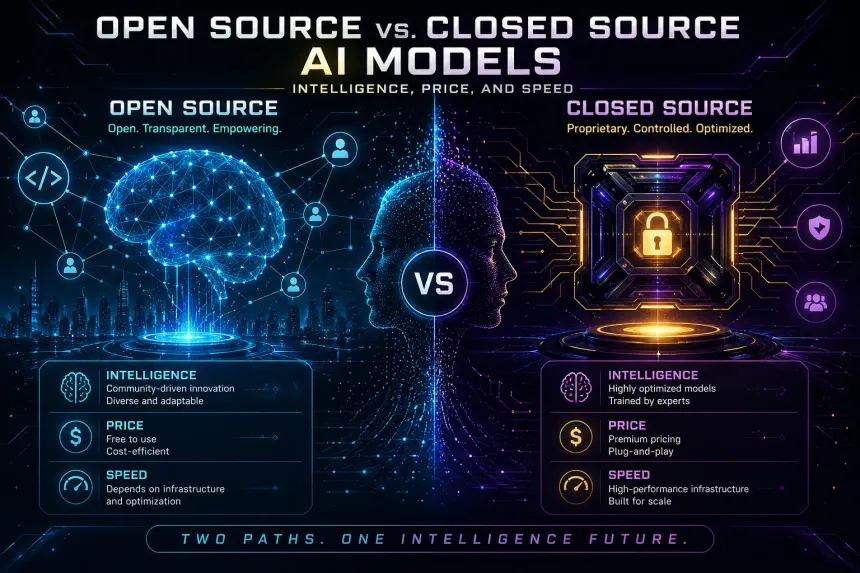

التحليل المقارن: مفتوح المصدر vs تجاري

وفقاً لـ SitePoint، المقارنة بين النموذجين في 2026 [citation:4]:

| البعد | مفتوح المصدر | التجاري (API) |

|---|---|---|

| التكلفة عند النطاق (50M+ رمز/يوم) | أقل بـ 40-60% | رسوم أعلى لكل رمز |

| الخصوصية | تحكم كامل، نشر محلي | نقل بيانات لطرف ثالث |

| الجودة | 3-5% خلف النماذج الرائدة | الأفضل للمنطق المعقد |

| النفقات التشغيلية | 0.5-1.0 مهندس DevOps | ضئيلة |

| نقطة التعادل (التوفير) | أكثر من 10-30 مليون رمز/يوم | أقل من 10 مليون رمز/يوم |

سعر استضافة نموذج مثل Llama 4 على GPU مخصص (مثلاً، عقد H100 لمدة سنة) يتراوح بين 0.20$ إلى 1.00$ لكل مليون رمز، حسب الخادم والكمية والضغط [citation:4].

التحديات الباقية

- “المصدر المفتوح” ليس كاملاً: معظم هذه النماذج هي “مفتوحة الوزن” فقط؛ بيانات التدريب وأكواد التدريب الكاملة ليست متاحة دائماً [citation:4]

- استهلاك الطاقة: تشغيل نموذج 70B يحتاج حوالي 140GB من VRAM (بطاقتا A100) في دقة FP16، لكن الضغط يقلص المتطلبات [citation:4]

- التكامل العربي: Llama 4 وQwen يدعمان العربية، لكن الأداء قد يختلف حسب المجال

- القيود الجغرافية: استخدام Llama 4 مقيد في الاتحاد الأوروبي حسب سياسة Meta [citation:5]

خلاصة

النماذج المفتوحة لم تعد مجرد بدائل أكاديمية — في 2026، هي خيار استراتيجي للشركات والمطورين. الفجوة مع GPT-4o و Claude تضيق بسرعة، مع تكلفة أقل بكثير عند النطاق الكبير.

للاطلاع على آخر النماذج والتحديثات:

مقارنة سريعة للتكلفة (API تقريبي، مليون رمز إدخال + مليون إخراج):

| النموذج | السعر (مليون رمز مختلط) |

|---|---|

| Llama 4 (مستضاف ذاتياً) | ~0.50$ |

| GPT-4o | 12.50$ (2.5$ إدخال + 10$ إخراج) [citation:4] |

| Claude Sonnet 4.6 | 18$ (3$ + 15$) [citation:6] |

| Mistral Large 2 (API) | 12$ (3$ + 9$) [citation:6] |

| Gemini 2.0 Pro | ~6.25$ (1.25$ + 5$) [citation:4] |

مع استمرار التطور السريع، تتجه الأنظار إلى ما إذا كانت النماذج مفتوحة المصدر ستتمكن من سد الفجوة بالكامل في السنوات القادمة.